文章詳情頁

python redis 列表插入 速度太慢

瀏覽:247日期:2022-06-27 17:15:54

問題描述

pool = redis.ConnectionPool(host=host, port=port)client = redis.StrictRedis(connection_pool=pool)for i in range(10000): for j in range(30):client.lpush(IDLE_TASKS, json.dumps(args))

這種執行效率低的可怕。需要等幾十秒,才能插入完成。請問有沒更高效率的處理手法?

args 只是以一個元組內容隨意(1,2,'3')之類

問題解答

回答1:因為我個人沒用過redis這個庫, 所以只能嘗試從你給出的代碼去給些建議, 不喜勿噴:

1.不知道你的這個args是哪來的, 但是在這個循環體中, 似乎沒看到改變, 所以能否將這個json.dumps(args)放到循環體外面執行:

args_dump = json.dumps(args)for i in range(10000): for j in range(30):client.lpush(IDLE_TASKS, args_dump)

2.看到你大概要生成30萬的同樣的數據, 能否將這個數據先生成, 再一次性client.lpush? 因為畢竟tcp也有自身的延遲因素

3.可以通過cProfile庫去找出耗時長的地方, 也可以嘗試換別的庫去實現(這個具體得自己去google了)

相關文章:

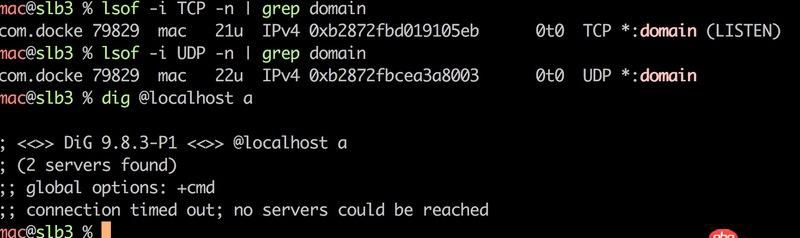

1. 關docker hub上有些鏡像的tag被標記““This image has vulnerabilities””2. docker - 如何修改運行中容器的配置3. Docker for Mac 創建的dnsmasq容器連不上/不工作的問題4. docker鏡像push報錯5. 前端 - @media query 使用出現的問題?6. 利用IPMI遠程安裝centos報錯!7. 運行python程序時出現“應用程序發生異常”的內存錯誤?8. docker 下面創建的IMAGE 他們的 ID 一樣?這個是怎么回事????9. phpstudy8.1沒集成mysql-front10. html - css氣泡,實現“倒三角(不知道算不算三角了)”可透明的。

排行榜

網公網安備

網公網安備