python - scrapy爬蟲不能循環運行?

問題描述

scrapy只能爬取一個頁面上的鏈接,不能持續運行爬完全站,以下是代碼,初學求指導。

class DbbookSpider(scrapy.Spider): name = 'imufe' allowed_domains = [’http://www.imufe.edu.cn/’] start_urls=(’http://www.imufe.edu.cn/main/dtxw/201704/t20170414_127035.html’) def parse(self, response):item = DoubanbookItem()selector = scrapy.Selector(response)print(selector)books = selector.xpath(’//a/@href’).extract()link=[]for each in books: each=urljoin(response.url,each) link.append(each)for each in link: item[’link’] = each yield itemi = random.randint(0,len(link)-1)nextPage = link[i]yield scrapy.http.Request(nextPage,callback=self.parse)

問題解答

回答1:是不是爬得太快讓封了

相關文章:

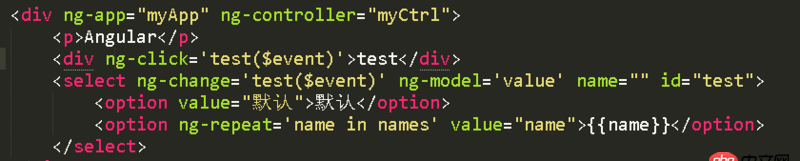

1. docker鏡像push報錯2. Docker for Mac 創建的dnsmasq容器連不上/不工作的問題3. 關docker hub上有些鏡像的tag被標記““This image has vulnerabilities””4. docker - 如何修改運行中容器的配置5. javascript - 請指條明路,angular的$event,在select中卻是undefined?6. java - 如何點擊按鈕,重新運行(我是初學者)?7. html5和Flash對抗是什么情況?8. javascript - 在 model里定義的 引用表模型時,model為undefined。9. docker 下面創建的IMAGE 他們的 ID 一樣?這個是怎么回事????10. phpstudy8.1沒集成mysql-front

網公網安備

網公網安備