Python 批量下載陰陽師網(wǎng)站壁紙

代碼復(fù)制可直接使用,記得pip install下載requests和bs4

最終版本# 引入系統(tǒng)類庫用于打開關(guān)閉文件import sys# 使用文檔解析類庫from bs4 import BeautifulSoup# 使用網(wǎng)絡(luò)請求類庫import requests#圖片保存目錄path = ’D:/陰陽師’ #陰陽師壁紙網(wǎng)站html_doc = 'https://yys.163.com/media/picture.html' # 請求requests_html_doc = requests.get(html_doc).text# 正則匹配所有href地址regex = re.compile(’.*?href='http://www.leifengta.com.cn/bcjs/(.*?)2732x2048.jpg' rel='external nofollow' ’)urls = regex.findall(requests_html_doc)# set集合可以防止下載的圖片重復(fù)result = set()for i in urls: result.add(i)# 計數(shù)器用于圖片命名num = 0# 文件路徑、操作模式、編碼 # r’’# 打開文件錄入圖片f = open(r’result.txt’, ’w’, encoding=’utf-8’)for a in urls: try:image_data = requests.get(a).contentimage_name = ’{}.jpg’.format(num) # 給每張圖片命名save_path = path + ’/’ + image_name # 圖片的保存地址with open(save_path, ’wb’) as f: f.write(image_data) print(image_name, ’=======================>下載成功!!!’) num = num+1 # 下一張圖片名字序號加一 except:pass# 關(guān)閉文件錄入f.close()print('rn掃描結(jié)果已寫入到result.txt文件中rn')過程借鑒代碼

自己從0開始,沒有頭緒,而且對python掌握度不高,那先借鑒別人的代碼開始,第一篇借鑒的代碼如下

# 引入系統(tǒng)類庫import sys# 使用文檔解析類庫from bs4 import BeautifulSoup# 使用網(wǎng)絡(luò)請求類庫import urllib.requestpath = ’D:/陰陽師’html_doc = 'https://yys.163.com/media/picture.html'# 獲取請求req = urllib.request.Request(html_doc)# 打開頁面webpage = urllib.request.urlopen(req)# 讀取頁面內(nèi)容html = webpage.read()# 解析成文檔對象soup = BeautifulSoup(html, ’html.parser’) # 文檔對象# 非法URL 1invalidLink1 = ’#’# 非法URL 2invalidLink2 = ’javascript:void(0)’# set集合可以防止下載的圖片連接重復(fù)result = set()# 計數(shù)器用于圖片命名num = 0# 查找文檔中所有a標(biāo)簽for k in soup.find_all(’a’): # print(k) # 查找href標(biāo)簽 link = k.get(’href’) # 過濾沒找到的 if(link is not None):# 過濾非法鏈接if link == invalidLink1: passelif link == invalidLink2: passelif link.find('javascript:') != -1: passelse: result.add(link)for a in result: # 文件路徑、操作模式、編碼 # r’’ f = open(r’result.txt’, ’w’, encoding=’utf-8’) # image_data = urllib.request.get(url=a).content image_data = requests.get(url=a).content image_name = ’{}.jpg’.format(num) # 給每張圖片命名 save_path = path + ’/’ + image_name # 圖片的保存地址 with open(save_path, ’wb’) as f:f.write(image_data)print(image_name, ’=======================>下載成功!!!’)num = num+1 # 下一張圖片名字序號加一f.close()print('rn掃描結(jié)果已寫入到result.txt文件中rn')思考urllib.request和requests

借鑒的代碼中使用urllib.request來請求,剛開始學(xué)習(xí)看到的一些代碼實例也常用urllib.request來發(fā)起請求,之后看到有的代碼使用的是requests。對于我個人,主觀感受requests更加便捷,少寫了幾行代碼,于是便去查閱了解兩者的區(qū)別。

BeautifulSoup接觸到了BeautifulSoup,并且在一些文章的評論中看到對BeautifulSoup的稱贊,進(jìn)入文檔查閱了下用法,改變了我之前對python,獲取文檔中部分特征的元素節(jié)點的寫法困難的印象。

Beautiful Soup 4.4.0 文檔

優(yōu)化處理之所以要加正則匹配,因為一開始獲取到的圖片鏈接里有空字符串的現(xiàn)象,在下載圖片的時候直接報錯整個程序掛掉,而且這個借鑒代碼中的invalidLink1和invalidLink2看起來屬實不舒服。所以添加了正則從源頭保證鏈接的有效性,并且在執(zhí)行下載代碼中,添加了try,except保證程序出錯也不會掛掉。

借鑒的代碼中每一次的下載,都會對要保存的目錄進(jìn)行打開和關(guān)閉,于是將打開關(guān)閉抽離到最外層,下載的邏輯放在里面,下載圖片成功的提速果然肉眼可見~

總結(jié)壁紙確實不戳~,希望下一個學(xué)習(xí)的腳本能更加有趣~

以上就是Python 批量下載陰陽師網(wǎng)站壁紙的詳細(xì)內(nèi)容,更多關(guān)于python 下載陰陽師網(wǎng)站壁紙的資料請關(guān)注好吧啦網(wǎng)其它相關(guān)文章!

相關(guān)文章:

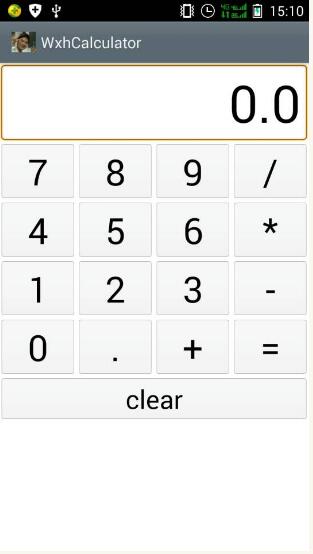

1. 理解PHP5中static和const關(guān)鍵字2. Android table布局開發(fā)實現(xiàn)簡單計算器3. python 代碼實現(xiàn)k-means聚類分析的思路(不使用現(xiàn)成聚類庫)4. IntelliJ IDEA安裝插件的方法步驟5. Java如何基于反射機(jī)制獲取不同的類6. php模擬實現(xiàn)斗地主發(fā)牌7. Vue封裝一個TodoList的案例與瀏覽器本地緩存的應(yīng)用實現(xiàn)8. Android 在 res/layout 文件夾 下創(chuàng)建一個 子文件夾實例9. PHP安全-命令注入10. Vuex localStorage的具體使用

網(wǎng)公網(wǎng)安備

網(wǎng)公網(wǎng)安備